贝叶斯定理

核心思想

不断根据新的证据,将先验概率调整为后验概率,使之更接近客观事实

条件概率

P(AB)=P(A)×P(B∣A)=P(B)×P(A∣B)

很容易理解: AB同时发生,就是A发生的情况下, B也发生。 或者B发生的情况下, A也发生。 两种理解分别对应P(AB)P(AB)P(AB)的两种表示。

先验概率和后验概率

举个例子

现在有两枚硬币,硬币A与硬币B,硬币A掷出去朝上概率为0.7,朝下为0.3。硬币B朝上概率为0.4,朝下为0.6。

现在你从中任选一枚硬币掷,已知,选中硬币A的概率为0.8,选中硬币B的概率为0.2。

现在,你掷出硬币,发现硬币正面朝上,这时要求判断:你选出的硬币是A还是B?

根据条件概率的定义, 我们可以用P(A∣硬币正面朝上),来表示基于目前已发生的硬币朝上的条件下,我们选硬币A的可能性。

同理,P(B∣硬币正面朝上),来表示选择硬币B的可能性。而贝叶斯优化所要做的,就是判断两者的大小关系,选择其中更大的一个。

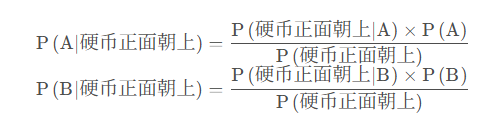

那么, 根据条件概率公式, 我们首先有:

P(A∣硬币正面朝上)×P(硬币正面朝上)=P(硬币正面朝上∣A)×P(A)

这里引出概念:

- P(A) 是选择A的概率,和结果(硬币朝上)无关的基于经验的概率,被称为先验概率。在本例中,先验概率就是:P(A)=0.8和P(B)=0.2。

- P(A∣硬币正面朝上) 则被称为后验概率,即根据目前发生的结果(硬币朝上)反推真相(选择了A还是B)的概率。

- 从上式中就能看出,后验概率和先验概率是相关的。

- 贝叶斯判定准则,就是选择后验概率最大的情况。这也最符合我们的逻辑, 根据已观测到的事实,反推最优可能造成该事实的原因是什么。

显然:

由于分母相同(事实上贝叶斯优化中都是如此),我们只需要比较分子的大小:

- 第一个等式的分子:P(硬币正面朝上∣A)×P(A)=0.7∗0.8=0.56;

- 第二个等式的分子:P(硬币正面朝上∣B)×P(B)=0.4∗0.2=0.08;

- 差距十分悬殊,毫无疑问,基于硬币朝上这一观测现象结果,选择A的概率是更大的。这个例子是小学初中的水平,但是这就是贝叶斯优化的实质:选择后验概率更大的那一个。

- P(硬币正面朝上∣A) 被称为类条件概率。

在机器学习中,先验概率和类条件概率很容易由训练集得到。比如总共有10000枚硬币(10000个样本),其中8000枚是A硬币,2000枚是B硬币(标签)。那么我们认为先验概率就是 P(A)=0.8,P(B)=0.2。

总结

就如同著名的西瓜分类例子之中: 我们在众多的西瓜(样本)里,发现好瓜的条纹清晰的概率远远大于坏瓜,那显然,当我们又看到一个新的条理清晰的瓜时,我们有理由判定它大概率是好瓜。 这就是贝叶斯分类的实质,也是我们生活中最符合常理的逻辑。